From 6c863bfbc4d088bf5139643bcd52b8e4e66086f7 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:13 +0300

Subject: [PATCH 04/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 34efa1ef877d..a0b94d45ac07 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -39,7 +39,7 @@ pip install git+https://github.com/huggingface/peft.git

## تحميل محول PEFT

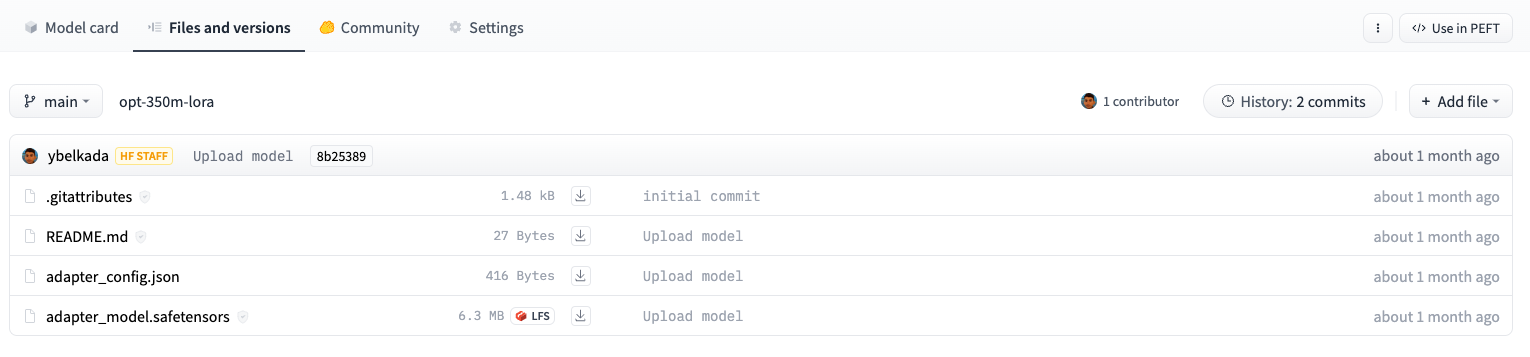

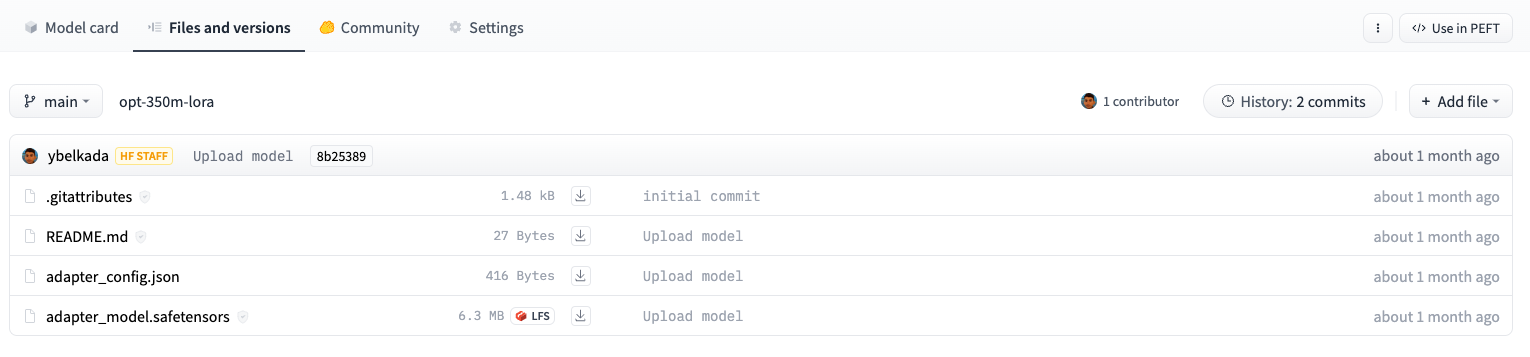

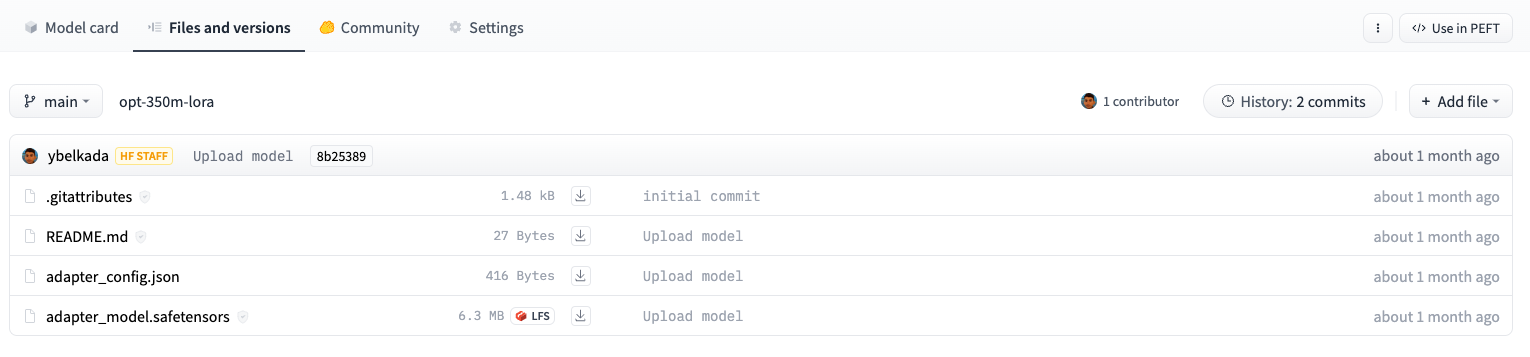

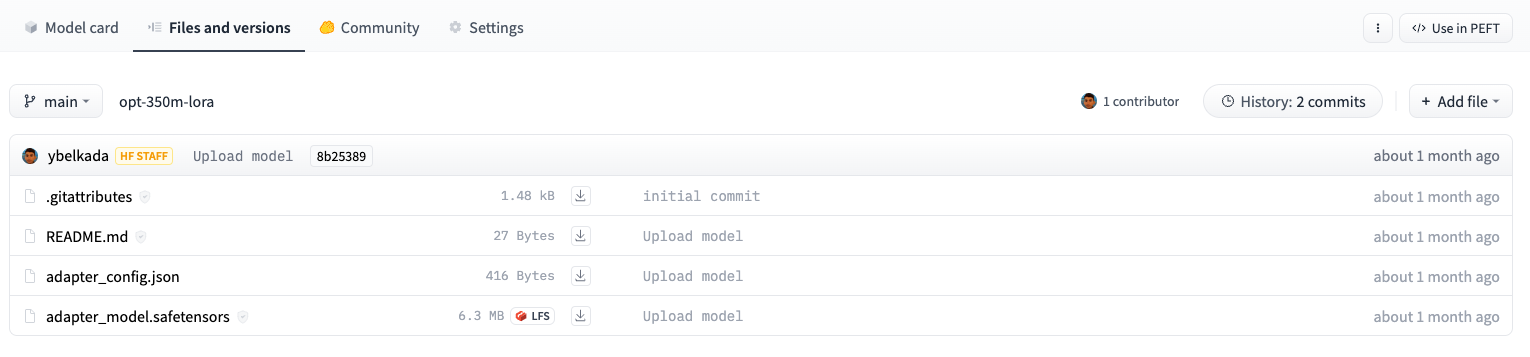

-لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحول، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محول PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

+لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحوّل، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محوّل PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

1. حدد معرف نموذج PEFT

2. مرره إلى فئة [`AutoModelForCausalLM`]

From 061edd006838492664e39c4574b2ea6a51c27375 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:25 +0300

Subject: [PATCH 05/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index a0b94d45ac07..831493d5bf13 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -1,4 +1,4 @@

-# تحميل المحولات باستخدام 🤗 PEFT

+# تحميل المحوّلات باستخدام 🤗 PEFT

[[open-in-colab]]

From b9949f80dda2a066cee6a115013bf9f3435a3682 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:35 +0300

Subject: [PATCH 06/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 831493d5bf13..9713ac242526 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -41,7 +41,7 @@ pip install git+https://github.com/huggingface/peft.git

لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحوّل، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محوّل PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

-1. حدد معرف نموذج PEFT

+1. حدد معرف النموذج لPEFT

2. مرره إلى فئة [`AutoModelForCausalLM`]

```py

From 3b864eb5e7d2a420b79a28cde0d6331d898da7a8 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:45 +0300

Subject: [PATCH 07/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 9713ac242526..2b57367a7bec 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -77,7 +77,7 @@ model.load_adapter(peft_model_id)

## التحميل في 8 بت أو 4 بت

-تدعم تكامل `bitsandbytes` أنواع بيانات الدقة 8 بت و4 بت، والتي تكون مفيدة لتحميل النماذج الكبيرة لأنها توفر الذاكرة (راجع دليل تكامل `bitsandbytes` [guide](./quantization#bitsandbytes-integration) لمعرفة المزيد). أضف `load_in_8bit` أو `load_in_4bit` المعلمات إلى [`~PreTrainedModel.from_pretrained`] وقم بتعيين `device_map="auto"` لتوزيع النموذج بشكل فعال على الأجهزة لديك:

+يدعم تكامل `bitsandbytes` أنواع بيانات الدقة 8 بت و4 بت، والتي تكون مفيدة لتحميل النماذج الكبيرة لأنها توفر مساحة في الذاكرة (راجع دليل تكامل `bitsandbytes` [guide](./quantization#bitsandbytes-integration) لمعرفة المزيد). أضف المعلمات`load_in_8bit` أو `load_in_4bit` إلى [`~PreTrainedModel.from_pretrained`] وقم بتعيين `device_map="auto"` لتوزيع النموذج بشكل فعال على الأجهزة لديك:

```py

from transformers import AutoModelForCausalLM, AutoTokenizer, BitsAndBytesConfig

From 62bdf98d138cd7def453606d1ba5aac7c8081b2c Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:59 +0300

Subject: [PATCH 08/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 2b57367a7bec..d12470f847f1 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -88,7 +88,7 @@ model = AutoModelForCausalLM.from_pretrained(peft_model_id, quantization_config=

## إضافة محول جديد

-يمكنك استخدام [`~peft.PeftModel.add_adapter`] لإضافة محول جديد إلى نموذج بمحول موجود طالما أن المحول الجديد هو من نفس نوع المحول الحالي. على سبيل المثال، إذا كان لديك محول LoRA موجود ملحق بنموذج:

+يمكنك استخدام الدالة [`~peft.PeftModel.add_adapter`] لإضافة محوّل جديد إلى نموذج يحتوي بالفعل على محوّل آخر طالما أن المحول الجديد مطابقًا للنوع الحالي. على سبيل المثال، إذا كان لديك محول LoRA موجود مرتبط بنموذج:

```py

from transformers import AutoModelForCausalLM, OPTForCausalLM, AutoTokenizer

From e9dd48ac5e08eba1c12d649e0161ab1892a8beee Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:52:08 +0300

Subject: [PATCH 09/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index d12470f847f1..83c1abf4f91f 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -168,7 +168,7 @@ output = model.generate(**inputs)

-1. حدد تكوين المحول باستخدام نوع المهمة وفرط المعلمات (راجع [`~peft.LoraConfig`] لمزيد من التفاصيل حول ما تفعله فرط المعلمات).

+1. حدد تكوين المحول باستخدام نوع المهمة والمعاملات الزائدة (راجع [`~peft.LoraConfig`] لمزيد من التفاصيل حول وظيفة هذه المعلمات).

```py

from peft import LoraConfig

From ce4db13e27385b74b766134686f1143c35e15e88 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:52:21 +0300

Subject: [PATCH 10/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 83c1abf4f91f..f5f050ade427 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -211,7 +211,7 @@ model = AutoModelForCausalLM.from_pretrained(save_dir)

## إضافة طبقات قابلة للتدريب إضافية إلى محول PEFT

-يمكنك أيضًا ضبط طبقات قابلة للتدريب إضافية أعلى نموذج به محولات مرفقة عن طريق تمرير `modules_to_save` في تكوين PEFT الخاص بك. على سبيل المثال، إذا كنت تريد أيضًا ضبط `lm_head` أعلى نموذج بمحول LoRA:

+يمكنك أيضًا إجراء تدريب دقيق لمحوّلات قابلة للتدريب إضافية فوق نموذج يحتوي بالفعل على محوّلات عن طريق تمرير معلم `modules_to_save` في تكوين PEFT الخاص بك. على سبيل المثال، إذا كنت تريد أيضًا ضبط دقيق لرأس النموذج اللغوي`lm_head` فوق نموذج بمحوّل LoRA:

```py

from transformers import AutoModelForCausalLM, OPTForCausalLM, AutoTokenizer

+

+  +

+  From 6c863bfbc4d088bf5139643bcd52b8e4e66086f7 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:13 +0300

Subject: [PATCH 04/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 34efa1ef877d..a0b94d45ac07 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -39,7 +39,7 @@ pip install git+https://github.com/huggingface/peft.git

## تحميل محول PEFT

-لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحول، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محول PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

+لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحوّل، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محوّل PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

1. حدد معرف نموذج PEFT

2. مرره إلى فئة [`AutoModelForCausalLM`]

From 061edd006838492664e39c4574b2ea6a51c27375 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:25 +0300

Subject: [PATCH 05/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index a0b94d45ac07..831493d5bf13 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -1,4 +1,4 @@

-# تحميل المحولات باستخدام 🤗 PEFT

+# تحميل المحوّلات باستخدام 🤗 PEFT

[[open-in-colab]]

From b9949f80dda2a066cee6a115013bf9f3435a3682 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:35 +0300

Subject: [PATCH 06/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 831493d5bf13..9713ac242526 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -41,7 +41,7 @@ pip install git+https://github.com/huggingface/peft.git

لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحوّل، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محوّل PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

-1. حدد معرف نموذج PEFT

+1. حدد معرف النموذج لPEFT

2. مرره إلى فئة [`AutoModelForCausalLM`]

```py

From 3b864eb5e7d2a420b79a28cde0d6331d898da7a8 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:45 +0300

Subject: [PATCH 07/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 9713ac242526..2b57367a7bec 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -77,7 +77,7 @@ model.load_adapter(peft_model_id)

## التحميل في 8 بت أو 4 بت

-تدعم تكامل `bitsandbytes` أنواع بيانات الدقة 8 بت و4 بت، والتي تكون مفيدة لتحميل النماذج الكبيرة لأنها توفر الذاكرة (راجع دليل تكامل `bitsandbytes` [guide](./quantization#bitsandbytes-integration) لمعرفة المزيد). أضف `load_in_8bit` أو `load_in_4bit` المعلمات إلى [`~PreTrainedModel.from_pretrained`] وقم بتعيين `device_map="auto"` لتوزيع النموذج بشكل فعال على الأجهزة لديك:

+يدعم تكامل `bitsandbytes` أنواع بيانات الدقة 8 بت و4 بت، والتي تكون مفيدة لتحميل النماذج الكبيرة لأنها توفر مساحة في الذاكرة (راجع دليل تكامل `bitsandbytes` [guide](./quantization#bitsandbytes-integration) لمعرفة المزيد). أضف المعلمات`load_in_8bit` أو `load_in_4bit` إلى [`~PreTrainedModel.from_pretrained`] وقم بتعيين `device_map="auto"` لتوزيع النموذج بشكل فعال على الأجهزة لديك:

```py

from transformers import AutoModelForCausalLM, AutoTokenizer, BitsAndBytesConfig

From 62bdf98d138cd7def453606d1ba5aac7c8081b2c Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:59 +0300

Subject: [PATCH 08/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 2b57367a7bec..d12470f847f1 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -88,7 +88,7 @@ model = AutoModelForCausalLM.from_pretrained(peft_model_id, quantization_config=

## إضافة محول جديد

-يمكنك استخدام [`~peft.PeftModel.add_adapter`] لإضافة محول جديد إلى نموذج بمحول موجود طالما أن المحول الجديد هو من نفس نوع المحول الحالي. على سبيل المثال، إذا كان لديك محول LoRA موجود ملحق بنموذج:

+يمكنك استخدام الدالة [`~peft.PeftModel.add_adapter`] لإضافة محوّل جديد إلى نموذج يحتوي بالفعل على محوّل آخر طالما أن المحول الجديد مطابقًا للنوع الحالي. على سبيل المثال، إذا كان لديك محول LoRA موجود مرتبط بنموذج:

```py

from transformers import AutoModelForCausalLM, OPTForCausalLM, AutoTokenizer

From e9dd48ac5e08eba1c12d649e0161ab1892a8beee Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:52:08 +0300

Subject: [PATCH 09/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index d12470f847f1..83c1abf4f91f 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -168,7 +168,7 @@ output = model.generate(**inputs)

-1. حدد تكوين المحول باستخدام نوع المهمة وفرط المعلمات (راجع [`~peft.LoraConfig`] لمزيد من التفاصيل حول ما تفعله فرط المعلمات).

+1. حدد تكوين المحول باستخدام نوع المهمة والمعاملات الزائدة (راجع [`~peft.LoraConfig`] لمزيد من التفاصيل حول وظيفة هذه المعلمات).

```py

from peft import LoraConfig

From ce4db13e27385b74b766134686f1143c35e15e88 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:52:21 +0300

Subject: [PATCH 10/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 83c1abf4f91f..f5f050ade427 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -211,7 +211,7 @@ model = AutoModelForCausalLM.from_pretrained(save_dir)

## إضافة طبقات قابلة للتدريب إضافية إلى محول PEFT

-يمكنك أيضًا ضبط طبقات قابلة للتدريب إضافية أعلى نموذج به محولات مرفقة عن طريق تمرير `modules_to_save` في تكوين PEFT الخاص بك. على سبيل المثال، إذا كنت تريد أيضًا ضبط `lm_head` أعلى نموذج بمحول LoRA:

+يمكنك أيضًا إجراء تدريب دقيق لمحوّلات قابلة للتدريب إضافية فوق نموذج يحتوي بالفعل على محوّلات عن طريق تمرير معلم `modules_to_save` في تكوين PEFT الخاص بك. على سبيل المثال، إذا كنت تريد أيضًا ضبط دقيق لرأس النموذج اللغوي`lm_head` فوق نموذج بمحوّل LoRA:

```py

from transformers import AutoModelForCausalLM, OPTForCausalLM, AutoTokenizer

From 6c863bfbc4d088bf5139643bcd52b8e4e66086f7 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:13 +0300

Subject: [PATCH 04/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 34efa1ef877d..a0b94d45ac07 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -39,7 +39,7 @@ pip install git+https://github.com/huggingface/peft.git

## تحميل محول PEFT

-لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحول، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محول PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

+لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحوّل، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محوّل PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

1. حدد معرف نموذج PEFT

2. مرره إلى فئة [`AutoModelForCausalLM`]

From 061edd006838492664e39c4574b2ea6a51c27375 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:25 +0300

Subject: [PATCH 05/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index a0b94d45ac07..831493d5bf13 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -1,4 +1,4 @@

-# تحميل المحولات باستخدام 🤗 PEFT

+# تحميل المحوّلات باستخدام 🤗 PEFT

[[open-in-colab]]

From b9949f80dda2a066cee6a115013bf9f3435a3682 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:35 +0300

Subject: [PATCH 06/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 831493d5bf13..9713ac242526 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -41,7 +41,7 @@ pip install git+https://github.com/huggingface/peft.git

لتحميل نموذج محول PEFT واستخدامه من 🤗 Transformers، تأكد من أن مستودع Hub أو الدليل المحلي يحتوي على ملف `adapter_config.json` وأوزان المحوّل، كما هو موضح في صورة المثال أعلاه. بعد ذلك، يمكنك تحميل نموذج محوّل PEFT باستخدام فئة `AutoModelFor`. على سبيل المثال، لتحميل نموذج محول PEFT للنمذجة اللغوية السببية:

-1. حدد معرف نموذج PEFT

+1. حدد معرف النموذج لPEFT

2. مرره إلى فئة [`AutoModelForCausalLM`]

```py

From 3b864eb5e7d2a420b79a28cde0d6331d898da7a8 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:45 +0300

Subject: [PATCH 07/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 9713ac242526..2b57367a7bec 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -77,7 +77,7 @@ model.load_adapter(peft_model_id)

## التحميل في 8 بت أو 4 بت

-تدعم تكامل `bitsandbytes` أنواع بيانات الدقة 8 بت و4 بت، والتي تكون مفيدة لتحميل النماذج الكبيرة لأنها توفر الذاكرة (راجع دليل تكامل `bitsandbytes` [guide](./quantization#bitsandbytes-integration) لمعرفة المزيد). أضف `load_in_8bit` أو `load_in_4bit` المعلمات إلى [`~PreTrainedModel.from_pretrained`] وقم بتعيين `device_map="auto"` لتوزيع النموذج بشكل فعال على الأجهزة لديك:

+يدعم تكامل `bitsandbytes` أنواع بيانات الدقة 8 بت و4 بت، والتي تكون مفيدة لتحميل النماذج الكبيرة لأنها توفر مساحة في الذاكرة (راجع دليل تكامل `bitsandbytes` [guide](./quantization#bitsandbytes-integration) لمعرفة المزيد). أضف المعلمات`load_in_8bit` أو `load_in_4bit` إلى [`~PreTrainedModel.from_pretrained`] وقم بتعيين `device_map="auto"` لتوزيع النموذج بشكل فعال على الأجهزة لديك:

```py

from transformers import AutoModelForCausalLM, AutoTokenizer, BitsAndBytesConfig

From 62bdf98d138cd7def453606d1ba5aac7c8081b2c Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:51:59 +0300

Subject: [PATCH 08/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 2b57367a7bec..d12470f847f1 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -88,7 +88,7 @@ model = AutoModelForCausalLM.from_pretrained(peft_model_id, quantization_config=

## إضافة محول جديد

-يمكنك استخدام [`~peft.PeftModel.add_adapter`] لإضافة محول جديد إلى نموذج بمحول موجود طالما أن المحول الجديد هو من نفس نوع المحول الحالي. على سبيل المثال، إذا كان لديك محول LoRA موجود ملحق بنموذج:

+يمكنك استخدام الدالة [`~peft.PeftModel.add_adapter`] لإضافة محوّل جديد إلى نموذج يحتوي بالفعل على محوّل آخر طالما أن المحول الجديد مطابقًا للنوع الحالي. على سبيل المثال، إذا كان لديك محول LoRA موجود مرتبط بنموذج:

```py

from transformers import AutoModelForCausalLM, OPTForCausalLM, AutoTokenizer

From e9dd48ac5e08eba1c12d649e0161ab1892a8beee Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:52:08 +0300

Subject: [PATCH 09/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index d12470f847f1..83c1abf4f91f 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -168,7 +168,7 @@ output = model.generate(**inputs)

-1. حدد تكوين المحول باستخدام نوع المهمة وفرط المعلمات (راجع [`~peft.LoraConfig`] لمزيد من التفاصيل حول ما تفعله فرط المعلمات).

+1. حدد تكوين المحول باستخدام نوع المهمة والمعاملات الزائدة (راجع [`~peft.LoraConfig`] لمزيد من التفاصيل حول وظيفة هذه المعلمات).

```py

from peft import LoraConfig

From ce4db13e27385b74b766134686f1143c35e15e88 Mon Sep 17 00:00:00 2001

From: Ahmed Almaghz <53489256+AhmedAlmaghz@users.noreply.github.com>

Date: Thu, 5 Sep 2024 01:52:21 +0300

Subject: [PATCH 10/10] Update docs/source/ar/peft.md

Co-authored-by: Abdullah Mohammed <554032+abodacs@users.noreply.github.com>

---

docs/source/ar/peft.md | 2 +-

1 file changed, 1 insertion(+), 1 deletion(-)

diff --git a/docs/source/ar/peft.md b/docs/source/ar/peft.md

index 83c1abf4f91f..f5f050ade427 100644

--- a/docs/source/ar/peft.md

+++ b/docs/source/ar/peft.md

@@ -211,7 +211,7 @@ model = AutoModelForCausalLM.from_pretrained(save_dir)

## إضافة طبقات قابلة للتدريب إضافية إلى محول PEFT

-يمكنك أيضًا ضبط طبقات قابلة للتدريب إضافية أعلى نموذج به محولات مرفقة عن طريق تمرير `modules_to_save` في تكوين PEFT الخاص بك. على سبيل المثال، إذا كنت تريد أيضًا ضبط `lm_head` أعلى نموذج بمحول LoRA:

+يمكنك أيضًا إجراء تدريب دقيق لمحوّلات قابلة للتدريب إضافية فوق نموذج يحتوي بالفعل على محوّلات عن طريق تمرير معلم `modules_to_save` في تكوين PEFT الخاص بك. على سبيل المثال، إذا كنت تريد أيضًا ضبط دقيق لرأس النموذج اللغوي`lm_head` فوق نموذج بمحوّل LoRA:

```py

from transformers import AutoModelForCausalLM, OPTForCausalLM, AutoTokenizer